Codziennie w internecie publikuje się setki tysięcy różnego rodzaju treści – od artykułów, po infografiki, materiały video, podcasty. Aparat poznawczy człowieka nie jest przystosowany do takiego gąszczu informacji. Nasze receptory są stale bombardowane kolejnymi szokującymi newsami, które nierzadko są najzwyczajniej w świecie fałszywe. Czym jest fake news i jego doskonalsza wersja, czyli deepfake i jak się przed nimi bronić?

Fakenews to modne słowo, którego popularność wzrosła w ciągu ostatnich lat, a jego popularność zawdzięczamy przede wszystkim mediom społecznościowym, które są doskonałym kanałem do wymiany informacji, ale także „siania” propagandy. Fakenews to nic innego jak fałszywa informacja. Motywacje do stworzenia fake newsa mogą być różne, warto jednak wyznaczyć podstawowe cele, jaki fake news może spełniać:

- Destabilizacja społeczeństwa / porządku społecznego

- Atak na konkretną grupę ludzi / mniejszość etniczną, religijną lub ze względu na orientację seksualną / kolor skóry etc.

- Podsycanie nienawiści, eskalacja konfliktów

- Wpłynięcie na wyniki wyborów (działalność kontrwywiadu)

Fake news jest jak wirus

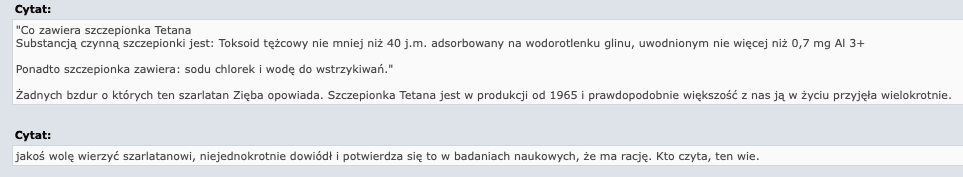

Fake news rozprzestrzenia się błyskawicznie w sprzyjających warunkach. Nosicielami są tutaj często niczego nieświadomi ludzie, którzy często padli ofiarą manipulacji i mogą nawet udostępniać fałszywą informację w dobrej wierze. Dobrym przykładem fakenewsa, który dość mocno zakorzenił się w polskim internecie, jest chociażby ten dystrybuowany przez proepidemików (osoby, które są przeciwne obowiązkowi szczepień).

W 2016 roku w „Immunologic Research” opublikowano artykuł naukowy na temat związku glinu zawartych w szczepionkach na odpowiedź autoimmunologiczną myszy. Artykuł był już wcześniej opublikowany w innym czasopiśmie i w ciągu miesiąca od publikacji został poddany niezwykle surowej krytyce, retrakcji, a autorom zarzucono wiele błędów metodologicznych, w konsekwencji czego został on uznany za pseudonaukowy. Publikacja została wycofana, uznana jako nierzetelna i fałszywa przez świat nauki1. Mimo to, argument „ad glinum” jest jednym z tych, którzy antyszczepionkowcy używają często w swojej argumentacji, a w internecie aż roki się od fake newsów na ten temat.

Źródło: http://www.sierzantundsaper.fora.pl/dlugi-mroczny-podwieczorek-dusz,29/medycyna-alternatywna,637-150.html

To tylko wierzchołek piramidy przeinaczeń i dowodów anegdotycznych, których proepidemicy produkują codziennie masę. Niestety, skutki ich działań są widoczne już dzisiaj:

Fakenewsy mogą realnie wpływać na poglądy, decyzje, nastroje społeczne i niestety – jak widać na przykładzie powyżej – mogą również stanowić bezpośrednie zagrożenie dla naszego zdrowia, a nawet życia.

Deepfake – fałszywka (prawie) nie do wykrycia

Klasyczne fake newsy są fabrykowane przez ludzi w określonym celu. Rewolucja technologiczna i rozwój sztucznej inteligencji, dają nowy oręż w tworzeniu fałszywych informacji. I nie chodzi tutaj jedynie o słowo pisane, ale także o materiały video czy audio.

Deepfake to materiały, które są tworzone za pomocą technologii deep learningu. W dużym uproszczeniu metoda deeplearningowa (czyli tak zwanego głębokiego uczenia się) polega na tym, że w proces „produkcji” treści (tekstowych, audio, wideo lub wszystkich naraz) bierze udział algorytm sztucznej inteligencji, która posiada sztuczną sieć neuronową – czyli ma być niczym innym, jak odbiciem / imitacją struktury ludzkiego mózgu. Taka właśnie sztuczna inteligencja jest w stanie zrobić fałszywki, nad którymi człowiek musiałby pracować tygodniami, czasem miesiącami, a nawet latami, a efekt i tak nie byłby aż tak widowiskowy, jak ten, który prezentuje sztuczna inteligencja:

Innym przykładem zatrważających możliwości sztucznej inteligencji jest algorytm OpenAI, któremu wystarczy jedynie zadać temat do napisania. Resztę zmyślonego artykułu program napisze już samodzielnie, bo został „wytrenowany” na ogromnej bazie danych artykułów napisanych przez ludzi. Wbudowany system przewidywania sprawia, że sztuczna inteligencja jest w stanie produkować fakenewsy w zastraszającym tempie na każdy temat, jaki nam się tylko przyśni.

Deepfake – jak się przed nimi bronić?

Nie ma jednej metody, która pozwoli nam rozpoznać Deepfake. Tym bardziej że algorytmy będą coraz dokładniejsze, szybsze i trudne do wykrycia. W przypadku fałszywej informacji tekstowej weryfikacja źródeł jest o wiele prostsza, natomiast zmanipulowane wideo czy materiał dźwiękowy, jest praktycznie nie do odróżnienia / wychwycenia przez zwykłego użytkownika, który nie jest ekspertem od tego typu manipulacji.

Poniżej krótki test. Jesteś w stanie odróżnić, który materiał został wypowiedziany przez człowieka, a który przez maszynę?

Należy mieć na uwadze, że powyższe materiały dźwiękowe zostały stworzone przez algorytm Google dwa lata temu. A technologia w tym obszarze rozwija się bardzo, bardzo dynamicznie.

Jak walczyć z deepfake i fake newsami

W przypadku informacji (bez względu na jej formę) warto posłużyć się następującymi metodami weryfikacji źródeł:

Metody konwencjonalne, czyli zadaj sobie pytanie:

- Czy materiał został opublikowany przez rozpoznawalne medium o dużym zasięgu i autorytecie?

- Czy przy materiale widnieje data opublikowania?

- Czy pod informacją podpisał się autor, podał źródła, z których korzystał?

- Czy autor jest dziennikarzem, publicystą, naukowcem, czy jego tożsamość jest weryfikowalna?

- Czy informacja / materiał ma mocne nacechowania emocjonalne?

- Sceptycyzm i jeszcze raz sceptycyzm, czyli stara Wolterowska zasada. Nigdy nie wierz od razu w to, co przeczytasz lub obejrzysz.

Metody automatyczne, czyli strony / inicjatywy (oprócz naszej), które zajmują się weryfikacją treści:

- www.snopes.com

- www.nytimes.com/spotlight/fact-checks

- www.washingtonpost.com/news/fact-checker/

- www.fakenewsai.com

- crosscheck.firstdraftnews.org

- sebenarnya.my

Warto pamiętać o tym, że prace nad algorytmami wykrywającymi deepfake trwają równolegle do rozwoju algorytmów, które manipulują materiałami wyjściowymi. Jako ciekawostkę można tutaj podać ostatnie doniesienie naukowców z University of Oregon. Ich hipoteza zakłada, że pomocne w wykrywaniu deepfake mogą być… myszy. Choć wydaje się to mało prawdopodobne, zespół naukowców odkrył, że po odpowiednim treningu, myszy były w stanie odróżnić dźwięki mowy w różnych kontekstach z 80% skutecznością.3

Ponieważ [myszy – przyp. red.] mogą nauczyć się naprawdę złożonego problemu kategoryzacji różnych dźwięków mowy, uważamy, że jest możliwe wytrenowanie myszy w zakresie wykrywania fałszywej i prawdziwej mowy – Powiedział BBC News Jonathan Saunders.

Z oczywistych względów Google czy Facebook nie zatrudnią myszy do wykrywania fejków, ale tego typu hipotezy mogą być bardzo przydatne do dalszych badań i późniejszych już nieco bardziej konkretnych wdrożeń.

Obecnie weryfikacją fałszywych informacji (i materiałów niezgodnych ze standardami potentatów medialnych Facebooka czy Google) nadal zajmują się głównie ludzie. Są oni często narażeni na oglądanie i czytanie treści, których nikt o zdrowych zmysłach nie chciałby czytać czy oglądać. Moderacje podzleca się oczywiście coraz częściej w krajach tak zwanego Globalnego Południa4, ale to już temat na inny artykuł.

Bibliografia

- Tomasz Witkowski, Zakazana psychologia. Tom 3. O cnotach, przywarach i uczynkach małych wielkich uczonych, Wydawnictwo Bez Maski, Wrocław 2018.

- Kristin Hauser, Scientists say mice could detect Deepfakes. Seriously, https://futurism.com/the-byte/mice-could-detect-deepfakes, dostęp: 2.10.2019, 19:58.

- Marta Klimowicz, Przekłuj swoją bańkę, „Magazyn Pismo”, Wrzesień 2019 (9).